近日,本组在联邦学习领域取得的新进展被KDD 2024录用。该成果以“Asynchronous Vertical Federated Learning for Kernelized AUC Maximization” 为题,提出了在不平衡数据与不平衡计算能力下仍可高效建模的纵向联邦学习算法。KDD(ACM SIGKDD Conference on Knowledge Discovery and Data Mining, 国际数据挖掘与知识发现会议)是中国计算机学会(CCF)推荐的数据挖掘领域A类国际学术会议。

纵向联邦学习(Vertical Federated Learning, VFL)因其隐私保护和多方协作建模的优势在人工智能领域引起了广泛关注。现有VFL算法主要关注模型的平均预测精度。然而,在面对不平衡数据时,基于平均精度的模型很难正确地对少数样本进行分类。AUC (Area Under the Curve) 是评估模型在不平衡数据上性能的有效指标。因此,以AUC为模型优化目标可以增强其处理不平衡数据的能力。此外,VFL系统中的计算资源通常是不平衡的,这使得同步VFL算法难以匹配现实应用场景。

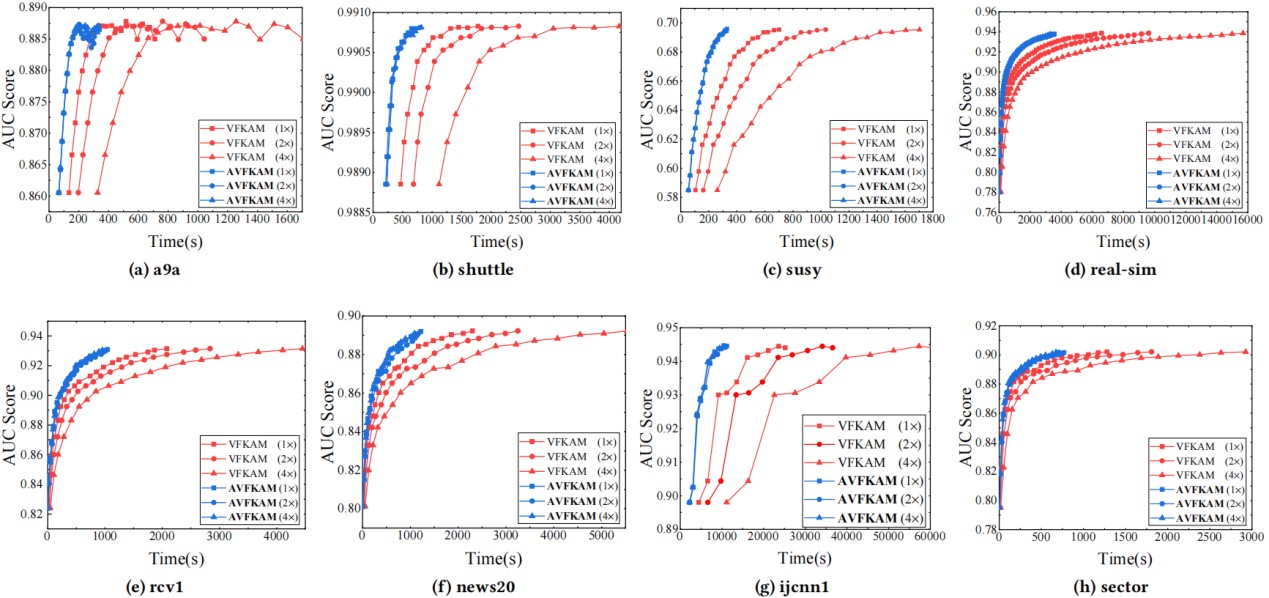

为了解决上述两个不平衡问题,本文提出了基于核方法的异步纵向联邦AUC最大化算法AVFKAM。理论上,证明了AVFKAM的收敛性和安全性。应用上,基准数据集上的实验结果表明AVFKAM保持了较高的AUC性能和效率。

我校信息学院2022级计算机应用技术方向硕士研究生张柯为论文第一作者,吉林大学顾彬教授和信息学院李函副教授为共同通讯作者,信息学院陈洪教授等参与了论文的指导工作。该工作获得国家自然科学基金面上项目,华中农业大学校自主创新基金和信息学院科研团队项目的支持。